Que faire lorsqu’une agence de renseignement américaine, manifestement bien aidée par ses petites camarades européennes, a — dixit Bruce Schneier, s’exprimant mercredi dernier lors de l’assemblée plénière de l’Internet Engineering Task Force, l’organisation qui rassemble les ingénieurs du réseau — « transformé l’Internet en une gigantesque plate-forme de surveillance » ?

Le problème, a-t-il ajouté, est « robuste politiquement, légalement et techniquement ». Il l’est d’autant plus que, la question étant fondamentalement politique — quelle « sécurité nationale », pour qui, comment, avec quel contrôle –, toute réponse technique est en dernière analyse une réponse politique, pas seulement dans ses attendus, mais aussi dans ses conséquences.

Depuis quelques mois, il y a réaffirmation par beaucoup de « techniciens » — du moins beaucoup de ceux qui s’expriment publiquement — d’une volonté de déjouer, par des moyens techniques et le plus rapidement possible, la surveillance de masse. La qualification « de masse » est tout sauf accessoire : on n’entend pas grand-monde dire qu’il faut empêcher toute surveillance en enlevant tout moyen aux autorités d’intercepter des communications. Certains le pensent sans doute (j’y reviendrai), mais la surveillance ciblée me semble être considérée comme un coût socialement acceptable, ou à tout le moins une fonction classique du pouvoir, ce qui n’est pas le cas de la surveillance indiscriminée et généralisée.

Les moyens techniques envisagés, depuis les tuyaux jusqu’à l’utilisateur final, se rangent, pour simplifier, en deux grandes catégories : déconcentration / distribution d’une part, opacification / chiffrement de l’autre. Parmi les hackers, les activistes du Net, les ingénieurs « civiques », bref, la vaste et diverse galaxie des défenseurs des libertés sur le réseau, le premier point fait consensus. Le second, beaucoup moins. Et même de moins en moins. Le débat n’est pas neuf mais sera sans doute, dans les mois à venir, de plus en plus vif et visible. C’est une question passionnante, très politique donc, et très complexe, qui mérite un peu de remise en perspective / en contexte. #workinprogress, as usual.

« Rebels With A Cause »

Quiconque s’intéresse à la cryptographie comme objet politique devrait avoir lu (ou lire fissa) le remarquable Crypto de Steven Levy. S’il faut autant de temps à un éditeur français pour se décider à le traduire qu’il en a fallu pour son Hackers, on n’est pas rendu avant… 2030 (le livre date de 2001). C’est fort dommage, mais d’ici là, ça vaut bien de faire un effort et au besoin de mettre le nez dans un Harrap’s. Crypto raconte, avec le souffle d’un roman épique, et une capacité de vulgarisation impressionnante, la longue bataille d’une poignée de mathématiciens et d’informaticiens pour mettre fin au monopole de la NSA sur la cryptographie aux États-Unis — au prix d’ennuis divers tels que pressions, interdictions de publication, enquêtes fédérales et menaces de procès.

Quiconque s’intéresse à la cryptographie comme objet politique devrait avoir lu (ou lire fissa) le remarquable Crypto de Steven Levy. S’il faut autant de temps à un éditeur français pour se décider à le traduire qu’il en a fallu pour son Hackers, on n’est pas rendu avant… 2030 (le livre date de 2001). C’est fort dommage, mais d’ici là, ça vaut bien de faire un effort et au besoin de mettre le nez dans un Harrap’s. Crypto raconte, avec le souffle d’un roman épique, et une capacité de vulgarisation impressionnante, la longue bataille d’une poignée de mathématiciens et d’informaticiens pour mettre fin au monopole de la NSA sur la cryptographie aux États-Unis — au prix d’ennuis divers tels que pressions, interdictions de publication, enquêtes fédérales et menaces de procès.

L’histoire commence dans la deuxième moitié des années 60, quand un type sec et malpoli, résident au MIT, collectionneur d’animaux exotiques (dont un python et une genette) et toujours muni d’une paire de baguettes chinoises, se prend de passion pour le chiffrement. Un défi mathématique, mais pas seulement :

« Il n’arrêtait pas de penser à la cryptographie, et à l’embargo silencieux qui la frappait. Et plus il y pensait, plus il comprenait à quel point cette question était essentielle. En particulier dans ce qu’il voyait comme l’ère naissante de l’omniprésence informatique. Plus les gens utiliseraient des ordinateurs, des téléphones sans fil, et d’autres objets électroniques, plus ils auraient besoin de la cryptographie. De la même manière que l’invention du télégraphe avait fait monter les enjeux crytographiques en faisant circuler des messages à l’air libre sur des milliers de kilomètres, offrant de nouvelles opportunités à toutes les oreilles indiscrètes, l’âge informatique verrait des milliards de messages passer du papier au royaume des bits. Non chiffrés, ces bits seraient des cibles faciles pour les fouineurs. La cryptographie, cette science délibérément éloignée des regards par les forces gouvernementales, pouvait-elle aider ? La réponse était claire comme de l’eau de roche.1 Bien sûr qu’elle le pouvait ! »

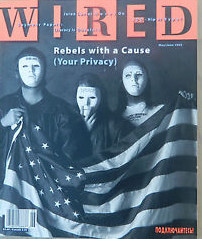

Le « il » en question, qui n’a attendu ni Echelon ni Prism pour mesurer l’ampleur du problème, n’est autre que Whitfield Diffie, l’inventeur, avec Marty Hellman, de la cryptographie asymétrique. Dès le début — avant même qu’on parle d’Internet ! — Whit Diffie fait de la cryptographie une question sociale. Au début des années 90, un petit groupe de libertariens de la côte Ouest va en faire une idéologie. Ce sont les cypherpunks, qui auront, en 1993, les honneurs de la couverture de Wired, sous le titre « Rebels with a Cause (Your Privacy) ». Leur credo : la généralisation de la cryptographie. Leur objectif : faire lever les restrictions légales pour la faire entrer dans le domaine public. Quant à leur projet de société, voici comment le définit John Gilmore, l’un des principaux animateurs de ce mouvement, lors d’une conférence en 1991 (citée dans Crypto) :

Le « il » en question, qui n’a attendu ni Echelon ni Prism pour mesurer l’ampleur du problème, n’est autre que Whitfield Diffie, l’inventeur, avec Marty Hellman, de la cryptographie asymétrique. Dès le début — avant même qu’on parle d’Internet ! — Whit Diffie fait de la cryptographie une question sociale. Au début des années 90, un petit groupe de libertariens de la côte Ouest va en faire une idéologie. Ce sont les cypherpunks, qui auront, en 1993, les honneurs de la couverture de Wired, sous le titre « Rebels with a Cause (Your Privacy) ». Leur credo : la généralisation de la cryptographie. Leur objectif : faire lever les restrictions légales pour la faire entrer dans le domaine public. Quant à leur projet de société, voici comment le définit John Gilmore, l’un des principaux animateurs de ce mouvement, lors d’une conférence en 1991 (citée dans Crypto) :

« Et si nous pouvions construire une société dans laquelle l’information ne serait jamais collectée ? Où vous pourriez louer une vidéo sans laisser un numéro de carte de crédit ou de compte bancaire ? Où vous pourriez prouver que vous avez un permis de conduire sans donner votre nom ? Où vous pourriez recevoir et envoyer des messages sans révéler où vous êtes, comme une boîte postale électronique ? Voilà le genre de société que je veux construire. Je veux garantir — à l’aide de la physique et des mathématiques, pas à l’aide de la loi — des choses comme la confidentialité réelle des communications personnelles […], un libre échange réel […], une réelle confidentialité financière […] et le contrôle réel de l’identification. »

Deux points me paraissent intéressants à soulever. 1/ Gilmore, et avec lui ses comparses Eric Hugues et Tim May, entendait alors sauver la vie privée par les algorithmes et non par la loi, considérée comme trop contingente. C’est un point de vue, là encore, extrêmement politique. Qu’on retrouve, par exemple, chez Assange aujourd’hui, dans cet extrait de Cypherpunks notamment2 :

« Mais peut-on dire qu’il y a deux manières d’aborder la surveillance de masse par les États : les lois de la physique et les lois humaines ? L’une consiste à utiliser les lois de la physique pour construire des dispositifs qui empêchent l’interception. L’autre consiste à établir des mécanismes de contrôle démocratique via la loi, pour rendre obligatoires les mandats, par exemple, et essayer d’obtenir un certain degré de responsabilité réglementaire. Mais l’interception stratégique ne peut pas s’inscrire dans ce cadre, elle ne peut pas être significativement limitée par la réglementation. L’interception stratégique signifie l’interception pour tous, sans se soucier de savoir qui est innocent ou coupable. […] Il y aura toujours un manque de volonté politique pour rendre public l’espionnage d’État. Et la technologie est fondamentalement si complexe, son utilisation en pratique si secrète, qu’il ne peut y avoir de contrôle démocratique significatif. »

J’ai pu retrouver un discours assez voisin dans la bouche d’Eleanor Saitta, ingénieure en sécurité pour l’Open Internet Tools Project, de passage au rassemblement de hackers OHM2013 pour un dynamique « call to arms » sous les tipis de Noisy Square :

« C’est une question de changement social, d’organisation collective. Ce n’est pas le travail politique qui changera les choses, c’est un changement de structures : les lois de la physique conjuguées à un changement social global. »

Points de vue qu’on jugera, selon où on se place, pour le moins pessimistes, ou lucides. Pourtant, 2/ Gilmore est, dans le même temps, l’un des fondateurs de l’Electronic Frontier Foundation, qui a précisément pour objet de faire pression dans le champ politique, un des exemples les plus aboutis de cette fameuse démarche de « hack de la loi » qu’on retrouve en France avec La Quadrature du Net, en Allemagne avec Digitale Gesellschaft ou aux Pays-Bas avec Bits of Freedom. Démarche qu’Eleanor Saitta m’a dit considérer comme nécessaire pour le « changement social global » dont elle parle. Autrement dit, entre les lois de la physique et les lois humaines, il y a bien des manières de positionner le curseur, selon le crédit qu’on accorde aux institutions, ou la possibilité qu’on entrevoit de les faire évoluer. Il me semble, par ailleurs, que les cypherpunks originels ont mis un peu d’eau dans leur vin, en considérant que certains problèmes ne peuvent (ou ne doivent) être entièrement résolus par la technique. (Et le tropisme libertarien est sans doute moins fort qu’à l’époque.) Croisé durant la Maker Faire de Rome, Bruce Sterling m’a d’ailleurs dit quelque chose comme (de mémoire) : « Les cypherpunks, ça n’existe plus, à part Assange. »

Points de vue qu’on jugera, selon où on se place, pour le moins pessimistes, ou lucides. Pourtant, 2/ Gilmore est, dans le même temps, l’un des fondateurs de l’Electronic Frontier Foundation, qui a précisément pour objet de faire pression dans le champ politique, un des exemples les plus aboutis de cette fameuse démarche de « hack de la loi » qu’on retrouve en France avec La Quadrature du Net, en Allemagne avec Digitale Gesellschaft ou aux Pays-Bas avec Bits of Freedom. Démarche qu’Eleanor Saitta m’a dit considérer comme nécessaire pour le « changement social global » dont elle parle. Autrement dit, entre les lois de la physique et les lois humaines, il y a bien des manières de positionner le curseur, selon le crédit qu’on accorde aux institutions, ou la possibilité qu’on entrevoit de les faire évoluer. Il me semble, par ailleurs, que les cypherpunks originels ont mis un peu d’eau dans leur vin, en considérant que certains problèmes ne peuvent (ou ne doivent) être entièrement résolus par la technique. (Et le tropisme libertarien est sans doute moins fort qu’à l’époque.) Croisé durant la Maker Faire de Rome, Bruce Sterling m’a d’ailleurs dit quelque chose comme (de mémoire) : « Les cypherpunks, ça n’existe plus, à part Assange. »

Sans doute les cypherpunks d’aujourd’hui ne sont-ils plus exactement ceux d’hier. Mais en tout état de cause, la cryptographie est une réponse politique à une question politique — et l’a toujours été, même avant d’être finalement soustraite au monopole de Fort Meade par l’union contingente des informaticiens libertariens et des promoteurs du commerce en ligne, qui avaient bien besoin d’outils de chiffrement, à la toute fin des années 90.

Secret inconditionnel (#oupas)

Tant qu’à mettre de l’eau dans leur vin, certains ont carrément arrêté de boire. Surtout connu aujourd’hui comme l’inventeur de l’hexayourte, un abri d’urgence facile à construire et à transporter, en licence libre, qui fait depuis trois ans la joie des participants au festival Burning Man, le jovial et volubile Vinay Gupta fut, dans les années 90, un cypherpunk actif. Il en est revenu après avoir pris conscience que, dans le cypherspace, circulaient aussi des gens très peu recommandables (« probablement la mafia russe », dit-il) :

« On écrivait des logiciels pour construire des espaces libérés de l’État. Sauf que “libérés de l’État”, ça voulait dire “libres pour les mafias”… On n’a pas un jeu clair avec deux acteurs, l’État et le peuple. On a l’État, le peuple et le crime organisé, et je n’aime pas du tout le crime organisé. La cryptographie, ça ne débouche pas sur ce qu’on considère comme étant la justice ; c’est soit le secret, soit pas le secret. Il n’y a pas d’idée de secret conditionnel que la société civile pourrait briser si tu fais quelque chose de vraiment mauvais. Il y a trois options possibles aujourd’hui : la bonne loi, la mauvaise loi ou pas de loi du tout. La bonne loi, c’est ce qu’on veut, mais on ne peut pas l’obtenir. De plus en plus, on a le choix entre la mauvaise loi et pas de loi du tout, qui sont deux options mauvaises. »

Dès lors qu’il peut continuer à publier tous ses travaux en Open Source, Vinay Gupta travaille avec les gouvernements. Même s’il avoue trouver un peu perturbant qu’une hexayourte soit construite chaque année au beau milieu du Pentagone, c’est un choix assumé :

« C’est cette analyse — bonne loi, mauvaise loi, pas de loi — qui me pousse à travailler avec les gouvernements. Parce que s’ils peuvent arrêter de débloquer, ils sont la meilleure chance qu’on ait d’avoir un monde décent — et s’ils continuent, on va finir avec une anarchie cryptologique, où les États vont crier famine parce que l’économie tournera avec des bitcoins et que les gens pratiqueront la désobéissance civile en refusant de payer des impôts… Je ne suis pas très optimiste sur la possibilité d’une transition douce de l’État-Nation à une sorte d’utopie, je crois plutôt à un passage de l’État-nation à un modèle façon Italie de la Renaissance, composé de petits royaumes plus ou moins mafieux. Donc je crois qu’il faut se battre pour renforcer l’État-Nation. »

Le tableau n’est pas très rassurant (un Schneier est plus mesuré dans ses anticipations, par exemple). Il est en tout cas très symptomatique de ce qui est principalement reproché à l’usage de la cryptographie, à savoir qu’elle protège de la même manière des défenseurs des libertés et des criminels, des cyberdissidents ou des narcotrafiquants. Le débat se posait à peu près dans les mêmes termes il y a plus de dix ans — y compris en France, autour du vote de la loi sur la société de l’information (LSI). Mais l’enjeu s’est déplacé : il ne s’agit plus d’obtenir la libéralisation d’une technologie, de manière à en autoriser l’utilisation, mais de pousser (#oupas) à un usage de masse.

Le tableau n’est pas très rassurant (un Schneier est plus mesuré dans ses anticipations, par exemple). Il est en tout cas très symptomatique de ce qui est principalement reproché à l’usage de la cryptographie, à savoir qu’elle protège de la même manière des défenseurs des libertés et des criminels, des cyberdissidents ou des narcotrafiquants. Le débat se posait à peu près dans les mêmes termes il y a plus de dix ans — y compris en France, autour du vote de la loi sur la société de l’information (LSI). Mais l’enjeu s’est déplacé : il ne s’agit plus d’obtenir la libéralisation d’une technologie, de manière à en autoriser l’utilisation, mais de pousser (#oupas) à un usage de masse.

Mon article pour Slate sur les travaux de l’IETF et la perspective d’un Internet « opaque » m’ont valu — assez logiquement, donc — cette interpellation :

Cet article ne manque pas un peu de profondeur, surtout sur les effets pervers évident ? : http://t.co/wMLQvs7CZl

— JM Planche (@jmplanche) November 9, 2013

« Effets pervers » qui, vendredi soir, étaient aussi clairement évoqués par Benjamin Bayart — président de la FFDN, la fédération des FAI associatifs, inlassable promoteur de la neutralité du Net et collectionneur de cravates réjouissantes en toutes circonstances — lors d’une conférence intitulée « Internet et ses enjeux », tenue à l’Institut Mines-Télécom dans le cadre du cycle « Il était une fois Internet » : « Les réponses techniques existent : faut-il les utiliser ? » (D’après lui : on y sera peut-être contraints, mais c’est une mauvaise solution.) À ma question : « ne faut-il pas plutôt se demander *jusqu’où* les utiliser ? » — la réponse a été la suivante : « La cryptographie, c’est zéro ou un. »

Techniquement parlant, c’est vrai. Socialement et politiquement parlant, c’est pour le moins discutable.

À point ou à bout ?

Ici, quelques explications techniques s’imposent (que ceux et celles chez qui ça provoque de l’urticaire me pardonnent, que ceux et celles qui savent déjà de quoi il retourne passent deux ou trois paragraphes). Quiconque a envie d’échapper aux regards pénétrants de No Such Agency (& other agencies) en utilisant la cryptographie a plusieurs outils à sa disposition. Certains relèvent du chiffrement dit « point à point » (point-to-point), d’autres du chiffrement dit « de bout en bout » (end-to-end encryption). En résumé, allégé, simplifié à l’extrême : dans le premier cas, le flux est illisible quand il transite, mais il est lisible par chaque intermédiaire le long de la chaîne de communication. Dans le second cas, il n’est lisible que par l’expéditeur et le destinataire.

Ainsi, Aurélie et Bertrand échangeant des e-mails via leurs comptes Gmail utilisent, sans le savoir, du chiffrement point à point : chacun se connecte à sa boîte en https (protocole sécurisé), et la seule manière de savoir ce qu’ils se racontent, et même de savoir qu’ils ont communiqué, est d’aller mettre le nez dans les serveurs de Google (ce qui n’a pas l’air très compliqué pour les regards pénétrants). Plus prudents, Adeline et Boris utilisent un client mail (au hasard, Thunderbird), une extension dédiée (Enigmail) et des clés de chiffrement (PGP ou plutôt OpenPGP pour les puristes). Seul Boris peut déchiffrer le message d’Adeline, et réciproquement. S’ils utilisent des comptes Gmail, les regards pénétrants peuvent quand même savoir sans trop de difficultés qu’ils ont communiqué (chez Google, seul le corps du message est chiffré), ce qui est déjà très intéressant (ce sont les métadonnées). S’ils ont des comptes chez un tiers un peu plus à cheval sur les principes, les regards pénétrants vont devoir s’adresser à ce tiers (c’est déjà moins « open bar »). Si Adeline et Boris ont chacun un serveur personnel, les regards pénétrants vont devoir débarquer chez Adeline (ou chez Boris) pour savoir de quoi il retourne.

Même différence pour la messagerie instantanée. André et Barbara, qui chattent sur Facebook toute la journée, communiquaient à ciel ouvert jusqu’à très récemment — il suffisait aux regards pénétrants de surveiller les bons tuyaux. Maintenant que la connexion à Facebook est sécurisée par défaut, il faut avoir accès aux serveurs de Facebook pour lire ce qu’ils se racontent. Antoine et Babette, eux, utilisent aussi leurs comptes Facebook pour chatter, mais passent par des clients de messagerie instantanée, et par une extension de chiffrement / authentification (Off The Record). Chez Facebook, on sait qu’ils se parlent, mais pas ce qu’ils se disent. Albert et Brigitte, eux, utilisent en prime des comptes de messagerie sur un serveur qui n’archive pas les données. Eux-mêmes n’archivent pas les conversations. Sauf à avoir accès à leurs ordinateurs au moment même où ils se parlent, on ne peut pas savoir ce qu’ils se disent, et ils peuvent même nier avoir communiqué : pas de traces.

Même différence pour la messagerie instantanée. André et Barbara, qui chattent sur Facebook toute la journée, communiquaient à ciel ouvert jusqu’à très récemment — il suffisait aux regards pénétrants de surveiller les bons tuyaux. Maintenant que la connexion à Facebook est sécurisée par défaut, il faut avoir accès aux serveurs de Facebook pour lire ce qu’ils se racontent. Antoine et Babette, eux, utilisent aussi leurs comptes Facebook pour chatter, mais passent par des clients de messagerie instantanée, et par une extension de chiffrement / authentification (Off The Record). Chez Facebook, on sait qu’ils se parlent, mais pas ce qu’ils se disent. Albert et Brigitte, eux, utilisent en prime des comptes de messagerie sur un serveur qui n’archive pas les données. Eux-mêmes n’archivent pas les conversations. Sauf à avoir accès à leurs ordinateurs au moment même où ils se parlent, on ne peut pas savoir ce qu’ils se disent, et ils peuvent même nier avoir communiqué : pas de traces.

L’intérêt de ces considérations techniques, ici, ce sont leurs effets politiques possibles, qui ne sont pas de même nature. Généraliser le chiffrement pour les protocoles courants (navigation, messagerie instantanée, courrier électronique), ce qui est l’objectif affiché par l’IETF à court terme, peut décourager l’interception indiscriminée des flux façon Tempora ou Muscular (on remarquera que les programmes de surveillance ont toujours des petits noms charmants). Ça ne règle en aucune manière le problème de la centralisation des données dans les datacenters des GAFA — la réponse, ici, c’est la décentralisation, ce que Schneier appelle la « dispersion des cibles » (target dispersal) qui, là encore, peut augmenter le coût de la surveillance de masse (il ne suffit plus d’aller se servir chez Google ou Facebook) : « Nous étions plus en sécurité quand nos e-mails étaient répartis entre 10.000 fournisseurs que quand il y en a 10. »

De fait, la feuille de route proposée par Schneier aux ingénieurs du réseau — développer le chiffrement point à point et déconcentrer — est bien un programme contre la surveillance de masse, pas contre la surveillance tout court. La surveillance ciblée — mieux socialement acceptée ou, du moins, tolérée en démocratie — n’en est pas particulièrement entravée. La généralisation du chiffrement de bout en bout, elle, compliquerait aussi la surveillance ciblée. Les effets politiques seraient sensiblement différents. Mais elle est bien plus complexe à mettre en place, ne serait-ce que parce qu’à ce stade, elle suppose une attitude active de l’utilisateur (certains travaillent à diminuer au maximum ce coût d’entrée).

D’après Benjamin Bayart, généraliser le chiffrement reviendrait à ce que « tout le monde se promène en armure sur Internet ». Ça se discute : le chiffrement end-to-end peut effectivement tenir de l’armure (ou de la cape d’invisibilité, c’est selon), mais le chiffrement point à point peut consister à ne pas se balader tout nu.

D’après Benjamin Bayart, généraliser le chiffrement reviendrait à ce que « tout le monde se promène en armure sur Internet ». Ça se discute : le chiffrement end-to-end peut effectivement tenir de l’armure (ou de la cape d’invisibilité, c’est selon), mais le chiffrement point à point peut consister à ne pas se balader tout nu.

« C’est zéro ou un » ? Ni l’un ni l’autre. C’est bien plus compliqué.

Ça l’est d’autant plus que « zéro ou un », c’est « toutes choses égales par ailleurs ». Exceptions faites, donc, de l’affaiblissement délibéré des logiciels utilisant la cryptographie, des attaques possibles pour tromper l’utilisateur (des faux certificats, par exemple), ou des portes dérobées logicielles ou matérielles. Entre autres. Les algorithmes de chiffrement sont solides, ce qu’il y a autour l’est moins ; en vérité il y a des « trous » possibles à tous les niveaux, et comme le dit Schneier, « la solution à la surveillance en ligne, c’est de jeter tous les ordinateurs à la poubelle ». Il y a peu de chances que ça arrive, avouons-le.

Sans compter les failles humaines : Ross Ulbricht, le fondateur de The Silk Road, a eu beau cacher son supermarché de la drogue dans les tréfonds de l’Internet, ça n’a pas empêché le FBI de remonter jusqu’à lui parce qu’il avait fait le malin sur des forums en ligne. Aucun outil mathématique n’empêche d’infiltrer et de remonter des filières — des techniques d’enquête qui certes, à la différence des écoutes, exposent physiquement ceux qui les utilisent, mais qui ont fait la preuve de leur efficacité. Notamment contre des gens socialement très dangereux qui ont déjà compris que l’Internet n’était pas le mode de communication le plus sûr. Ce sont plutôt les citoyens dit « lambda » qui semblent aujourd’hui les plus démunis.

Autrement dit : même avec une augmentation sensible du chiffrement, et même avec un phénomène de déconcentration des données (très aléatoire à ce stade), ça n’est pas « zéro ou un ». Plutôt quelque part entre 0,2 et 0,7 (chiffre au doigt mouillé, mais on s’en fiche). La réponse technique n’est pas une réponse politique binaire. Elle n’est évidemment pas non plus une réponse politique suffisante.

La politique de l’escalade

Un dernier retour en arrière (c’est souvent utile). En 1999, le chercheur néerlandais Bert-Jaap Koops publiait sa thèse de doctorat sous le titre The Crypto Controversy. Voici ce qu’en disait, à l’époque, le communiqué de presse :

« Koops […] a analysé le conflit d’intérêts que la cryptographie pose à la société. D’un côté, le chiffrement est essentiel à la sécurité de l’information et à la protection de la vie privée, mais de l’autre, il permet aux criminels d’échapper à la surveillance des forces de l’ordre. Les gouvernements tentent avec peine de répondre à ce conflit d’intérêts, mais leurs propositions en termes de régulation sont controversées. […] Pour répondre à cette controverse cryptographique, Koops aborde quatre solutions possibles : intégrer des systèmes d’accès aux clés de chiffrement [Law Enforcement Access to Keys], demander aux suspects de déchiffrer, utiliser des techniques d’enquête alternatives, et ne rien faire. La première option est défectueuse, parce que […] les criminels n’utiliseront pas d’outils cryptographiques contenant des portes dérobées pour la police. La seconde option […] n’offre que peu d’opportunités, à cause du droit de ne pas témoigner contre soi-même. Les techniques d’enquête alternatives, comme l’utilisation de micros directionnels ou l’interception du rayonnement émis par les écrans d’ordinateurs, peuvent offrir une certaine marge de manœuvre si les écoutes perdent de leur efficacité, mais elles sont une sérieuse infraction à la vie privée. Koops conclut qu’à l’heure actuelle, “l’option zéro” est préférable : les gouvernements devraient décider de ne rien faire quant au problème de la cryptographie. Pour s’ajuster aux développements de la criminalité et de la cryptographie, cette politique devrait être réévaluée périodiquement. »

Je ne sais pas ce qu’il en est aux Pays-Bas aujourd’hui, mais en France, le refus de remettre une clé de chiffrement est passible de trois ans d’emprisonnement et de 45.000 euros d’amende (article 434-15-2 du Code pénal) — ça peut faire réfléchir. Plus fondamentalement, ce qui me semble ressortir, entre autres, de ce résumé de la thèse de Koops, c’est qu’il considère que « l’escalade » (portes dérobées ou techniques d’interception alternatives) n’est pas une bonne idée, soit parce que ça ne sert à rien en matière de lutte contre la criminalité, soit parce que le coût en termes de libertés fondamentales est trop élevé.

Une escalade : est-ce que ce n’est pas précisément ce qui ressort des révélations d’Edward Snowden ?

Est-ce que les « effets pervers » de la cryptographie ne sont pas, d’abord, les « effets pervers » de la surveillance ?

Est-ce que développer le chiffrement consiste à répondre à une escalade par une autre escalade, ou à rétablir un équilibre ? Ou les deux ? Ou ça dépend comment, et jusqu’où ?

Qu’est-ce qui a le coût le plus élevé, sur le plan politique, pour une société : l’inconditionnalité du secret cryptographique, ou la transparence totale de la surveillance généralisée ?

Ceux qui savent se protéger en ligne, mais qui pensent que la démocratisation des outils cryptographiques pourrait poser problème, sont-ils prêts à y renoncer personnellement ?

Troll #1 : si ces outils posent un problème, la liberté d’y accéder pose-t-elle, elle aussi, un problème ? (Back to 2001.)

Troll #2 : considérer qu’ils doivent être libres, mais qu’il vaut mieux que seule une minorité les utilise, ça ne serait pas élitiste ?

Poser ce genre de question ne résoud pas le problème posé. Mais poser des questions, c’est un peu mon métier. Et les réponses relèvent en effet de la politique. Dont la technique (ou la politique technique, ou la technopolitique) est l’un des aspects. Un élément parmi d’autres pour analyser les rapports de force, un poids dans la balance, une part de dialectique. Comme elle l’a été dans les années 90 à l’époque des « guerres de la cryptographie », avec une distribution des rôles sensiblement différente.

Ceux qui pensaient sauver la vie privée avec les mathématiques ont sans doute, avec le recul, remporté à l’époque une victoire à la Pyrrhus. Mais l’histoire montre, à tout le moins, que rien n’est statique — pas même les murs de Fort Meade. Et elle est, d’évidence, loin d’être terminée.

——

- En anglais clear as plaintext, hélas intraduisible avec élégance (plaintext signifie « texte en clair »). ↩

- Traduction maison, qui vaut sans doute bien celle de Robert Laffont, chez qui on traduit encryption par « cryptage ». ↩

Si beaucoup de monde réclame des mesures contre la surveillance généralisée, en laissant de côté la surveillance ciblée, ce n’est pas uniquement parce qu’ils pensent la seconde plus acceptable et plus justifiée. C’est aussi par réalisme. Rendre difficile ou très coûteuse, la surveillance généralisée, c’est envisageable. Empêcher toute atteinte à la vie privée dans le monde numérique, c’est une autre paire de manches !

C’est vrai. Cela dit, la justification de la surveillance de masse est très rare (sauf chez des gens qui pensent que la vie privée n’a pas à être spécialement défendue, évidemment), mais l’idée qu’il faille laisser une marge de manoeuvre à la police pour traquer les « méchants » est plus courante. Je pense que le niveau d’acceptation sociale n’est pas exactement le même.

(Mais par ailleurs ça laisse évidemment entière toute la question du contrôle démocratique sur les dispositifs de surveillance — ou plutôt d’absence de contrôle. On a une belle tradition en la matière, en France.)

Billet intéressant, partant un peu tous azimuts cependant 😉

La problématique consiste donc en gros à

1. développer les usages cryptographiques facile à mettre en œuvre et empêchant la surveillance de masse

2. exiger du politique des comptes sur ladite surveillance de masse, pour l’interdire explicitement, et surveiller les surveillants (ce dernier point étant non évoqué ici)

Je note par ailleurs qu’on oublie souvent les différences légales entre nos pays: le fait de ne pas pouvoir s’accuser soi-même est spécifiquement américain, les preuves d’identités plus exigeantes en France qu’en UK etc.

Si j’avais abordé la « surveillance des surveillants », ça partirait encore plus dans tous les sens 😉 c’est surtout que c’est une question plus générale de contrôle démocratique, et de ses mécanismes (il est vrai que ce domaine est encore plus sous le radar citoyen que d’autres).

Je crois qu’il y a effectivement un consensus social très large sur le fait que la surveillance de masse n’est pas acceptable en démocratie. Et la solution passe, me semble-t-il, à la fois par des mesures techniques (le programme de l’IETF est assez clair : passer d’un Internet vulnérable à un Internet sûr pour tous) *et* par des mesures politiques (et en effet, le contrôle est nécessaire car entre le texte et la pratique, il peut y avoir des différences, disons, significatives).

Ceci étant : la surveillance ciblée est un autre problème. Je croise des gens qui considèrent qu’elle est un mal nécessaire, d’autres qui pensent qu’on ne peut rien y faire, d’autres pour qui elle est une grave atteinte à la vie privée. Et qui, dès lors, considèrent qu’il faut la rendre, elle aussi, coûteuse. Ce que permettent précisément les outils de chiffrement end-to-end. C’est là-dessus qu’il y a bien sûr débat, et c’est là-dessus qu’il y a un choix, personnel et collectif, éthique et politique : entre le coût politique du secret cryptographique à la portée de tous et le coût politique des atteintes à la vie privée.

Je dirais qu’il faut se situer politiquement: C’est une problématique sociale, une contrainte donc quelque part un appui. La démocratie doit être défendue voir l’EITF.

Le chiffrement point-à-point peut être une solution contre la surveillance de masse opérée par les États, mais seulement si on diversifie les points de transit plutôt que de tout avoir centralisé chez Google/Facebook/Apple. D’autre part, ça n’empêche pas la surveillance du fait de l’opérateur du point en question ! Et tant que l’intérêt économique reposera sur l’exploitation de ces données, j’ai dû mal à voir comment on pourra décentraliser alors que le marché est dominé par des ultra-gros.

Soit on a un changement de modèle économique de la part de Google et Facebook (j’ai dû mal à voir quoi) ; soit on cherche l’autre solution, le chiffrement de bout en bout et tout bonnement, se passer des serveurs.

Bref, tout ça pour dire, le chiffrement n’est pas la seule donnée technologique à prendre en compte pour savoir quel modèle peut être le plus apte à assurer une meilleure « privacy »¹ mais on peut aussi aller voir du côté d’applications unhosted et pair-à-pair.

Bon, ce que j’écris ne veut rien dire en ce moment. Je m’arrête et j’y réfléchirais davantage pour mettre ça en mots !

—

1. Désolé mais j’arrive vraiment pas à traduire privacy par vie privée ni protection de la vie privée.

Euh si, ça a du sens (enfin pour moi) 😉

Dans l’absolu je vois bien ce que tu veux dire, à savoir : chiffrement point à point sans « target dispersal » = coup d’épée dans l’eau. Mais je crois que ça dépend en partie du coût de la surveillance pour les « gros silos » -> si ça coûte trop cher d’être trop open, ils peuvent aussi essayer de fermer un peu les vannes, et rien que ça, ça modifie déjà les paramètres. Si leur intérêt bien compris est de mieux protéger leurs utilisateurs de leur gouvernement, c’est une option possible. (Ce n’est pas de la naïveté, les guerres de la crypto montrent précisément comment l’intérêt économique peut primer sur les impératifs du renseignement. #dialectique toussa) On sent ça un peu chez Google, déjà, et c’est intéressant d’observer la manière dont ils réagissent en ce moment.

Ça ne les empêchera évidemment pas d’exploiter eux-mêmes ces données, et je suis bien d’accord que l’hypercentralisation est un énorme problème. Schneier le disait assez justement, toujours à la plénière de l’IETF : « La NSA ne s’est pas réveillée en disant : allons espionner tout le monde. Ils ont regardé et ont dit : wow, les grosses boîtes espionnent tout le monde, on n’a qu’à s’en faire une copie. »

La manière dont ça va évoluer va dépendre, entre autres, de l’émergence d’alternatives user-friendly (j’en parle beaucoup là) et, là encore, du coût anticipé pour les géants du Net. Je maintiens que leur objectif n’est pas de surveiller leurs utilisateurs, leur objectif est de faire des sous, c’est différent. L’agrégation des données, le tracking, ça rapporte et c’est pour ça qu’ils le font. Moi non plus je ne vois pas forcément vers quel autre modèle ils pourraient s’orienter, mais ça ne veut pas dire que ça ne va pas bouger.

Personnellement je ne crois pas que tout le monde va du jour au lendemain s’auto-héberger, ou passer à des applis en pair à pair, mais il peut y avoir des formes de déconcentration, des gens qui mettront leur courrier ailleurs que chez Gmail par exemple. Même si c’est minoritaire, si ça cesse d’être marginal, ça aussi, ça modifie les paramètres.

À l’heure actuelle on a une immense majorité d’utilisateurs qui s’exposent à la surveillance, et une toute petite minorité qui prend beaucoup de précautions — et qui du coup attire forcément l’attention. Il n’y aura pas de bascule, je crois, en tout cas pas à court ni même moyen terme, mais il peut y avoir émergence de positions « intermédiaires », un spectre beaucoup plus diversifié — et c’est ça qui va être intéressant. Ça pourrait déjà substantiellement augmenter le coût de l’espionnage.

Et aussi :

« ça n’empêche pas la surveillance du fait de l’opérateur du point en question »

Non, bien sûr, mais plus ils sont nombreux, plus ça complique le boulot. Et c’est aussi une question de droit : s’il y a besoin d’un papier signé par un juge pour aller regarder, ça offre (heureusement) quelques garanties.

Dans le genre ouvrages de vulgarisation sur la crypto, les bouquins de Neil Stephenson, dont certains sont traduits en français : http://fr.wikipedia.org/wiki/Cryptonomicon